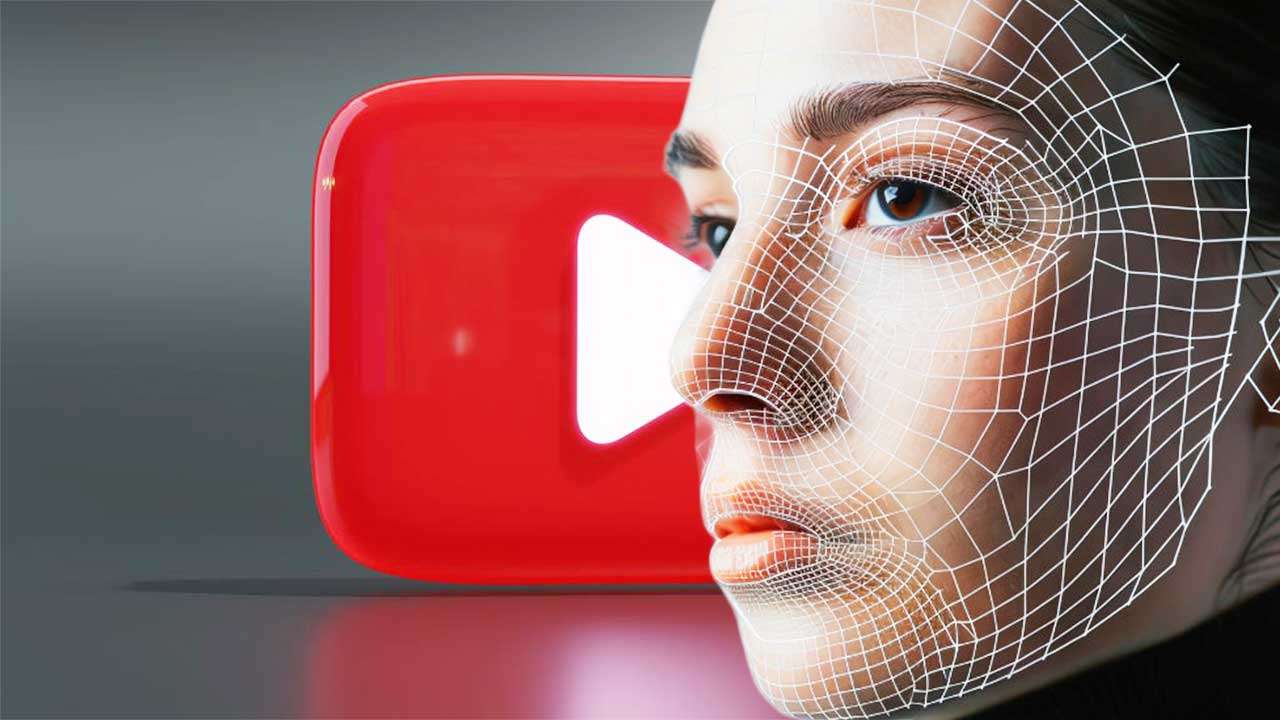

YouTube ha puesto en marcha una nueva herramienta basada en inteligencia artificial (IA) para ayudar a los creadores de contenido a identificar vídeos manipulados o falsos que utilicen su imagen o su voz sin permiso.

El sistema, que se encuentra en fase beta, permite detectar deepfakes y solicitar su retirada mediante un proceso de revisión directa desde YouTube Studio. La plataforma prevé extenderlo a todos los creadores que monetizan sus vídeos a principios de 2026.

Una IA al servicio de la identidad digital

La función está diseñada para supervisar el uso no autorizado del rostro o la voz de los usuarios, incluso en vídeos generados con IA que alteren su identidad o transmitan mensajes falsos.

El proceso se inicia desde el panel de “Detección de contenido”, donde el creador puede realizar una búsqueda de semejanza facial.

Si la herramienta encuentra coincidencias, mostrará los vídeos sospechosos para que el usuario confirme si hay manipulación o suplantación.

“Queremos que los creadores tengan control sobre cómo aparece su imagen en la plataforma”, explican desde YouTube.

“La IA no debe ser un riesgo para la reputación ni la integridad digital.”

Denuncias simplificadas y control sobre la voz

En caso de detectar un uso indebido, el creador podrá iniciar una denuncia formal por suplantación de identidad o manipulación.

El sistema también cubre la imitación de voz, cada vez más usada en deepfakes sofisticados que logran replicar tonos y patrones vocales reales.

Para activar la función, los usuarios deben verificar su identidad mediante reconocimiento facial, garantizando así que el proceso no se utilice de forma abusiva.

El reto de los deepfakes en la era de la IA

Los deepfakes han pasado de ser una curiosidad digital a convertirse en un riesgo real de desinformación y fraude audiovisual.

YouTube busca adelantarse a este fenómeno ofreciendo una respuesta automatizada y preventiva, combinando aprendizaje profundo y verificación biométrica.

Esta medida complementa los esfuerzos de otras plataformas, como TikTok o Meta, que también están desarrollando filtros automáticos para detectar manipulación de IA en contenido visual.

Innovación y responsabilidad

El lanzamiento refuerza el compromiso de la plataforma con la transparencia y la protección de los creadores, en un momento en que la IA generativa multiplica tanto las oportunidades creativas como los riesgos reputacionales.

“El futuro de los contenidos digitales dependerá de saber equilibrar la creatividad con la veracidad”, apuntan analistas del sector.

Te puede interesar

- Investigación sobre la privacidad en redes sociales y el uso de datos personales

- Alerta por la estafa de las criptomonedas en España: un fraude en expansión

- La crisis global en los motores de búsqueda: Google, en el punto de mira

- RTVE inaugura su nuevo centro de producción digital

- Gavira exige a Moreno Bonilla que proteja los datos de los andaluces